Tempo estimado de leitura: 5 minutos

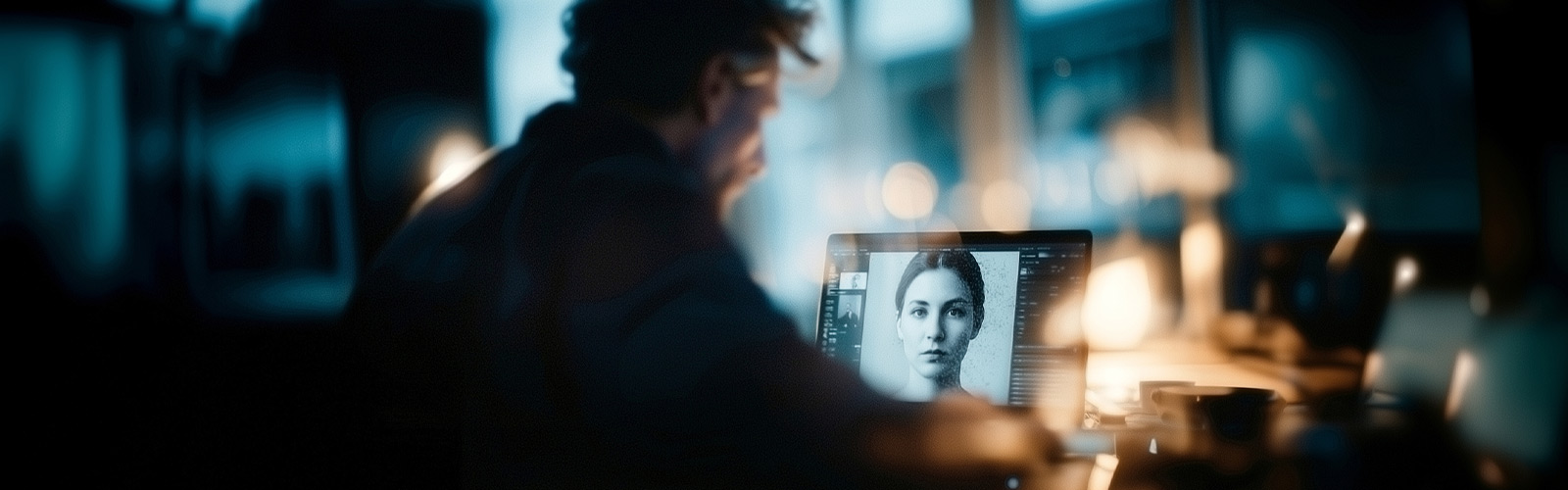

A inteligência artificial domina várias áreas e em todas pode fazer a diferença para o bem, mas também para o mal, nomeadamente para as burlas online. Inteligência Artificial generativa permite tal sofisticação que cria imagens e sons de pessoas reais em contextos inimagináveis e muitas vezes embaraços.

Estes esquemas com deepfake começam a tornar-se virais e é importante estar vigilante para os saber identificar, evitar e denunciar. Explicamos tudo para não cair no engodo.

O que é a deepfake?

Quando os conteúdos, som ou imagem, são sintéticos ou seja fabricados de modo muito próximo da realidade que pretendem imitar, estamos diante da deepfke.

Este fenómeno, mais recente que as já conhecidas fakenews, vale-se das novas tecnologias; da sofisticação e do alcance da inteligência artificial generativa para que os rostos, vozes, gestos de pessoas reais sejam manipulados, descontextualizados e aproveitados para improvisar esquemas de fraude.

Pior, estes esquemas atingem tal grau de sofisticação e aparente rigor ou perfeição que conseguem ludibriar barreiras quer legais quer até da própria tecnologia. O efeito negativo destas manobras é complexo e vem confundir daquilo que é real com aquilo que é falso.

O termo combina os conceitos deep learning (aprendizagem profunda) e fake (falso). Na prática, recorre a redes neuronais adversárias generativas (GAN), onde a Inteligência artificial cria as falsificações (isto ao mesmo tempo que tenta detetá-las, aperfeiçoando-se mutuamente até produzir resultados praticamente indistinguíveis da realidade

As fraudes digitais: a urgência de nos defendermos

Tanto empresas, entidades oficiais, como famílias e particulares estão permanentemente a ser alvo de tentativas de fraude, esquemas extorsão ou crime digital.

São inúmeros os relatos de esquemas online que visam roubar a identidade ou o património de todos quantos ainda não estão despertos para esta realidade. O Gabinete de Combate ao Cibercrime da Procuradoria Geral da República tem vindo a lançar vários alertas sobre as ultimas tendências neste tipo de fraudes.

De acordo com o estudo Corporate Fraud Survey 2025 da Deloitte, 28% das empresas nacionais foram alvo de fraude em 2025, nomeadamente com ataques cibernéticos; esquemas que envolvem os meios de pagamento e apropriação indevida de ativos.

Já o Relatório Thales – Threat Landscape Report 2025, dá conta de que o cibercrime em Portugal cresceu 180% em 2025, especialmente ataques de ransomware e que entre janeiro e junho de 2025, pelo menos 14 entidade foram visadas por estes ataques.

Em janeiro de 2025 e de acordo com a Serasa Experian, o mercado brasileiro registou 1,2 milhões de tentativas de fraude.

Leia também:

- Cheque formação digital: 750 euros para aprofundar conhecimentos na área digital

- Já usou a Chave Móvel Digital?

- Serviços públicos online: saiba o que pode fazer sem sair de casa

Deepfake alarma pela sofisticação da fraude

A realidade tecnológica está a mudar muito rapidamente e a colocar cada vez mais desafios – tanto do lado da prevenção, com sensibilização e alertas para incentivo das boas práticas, como dos passos a dar para reagir quando a fraude acontece. Pelo seu grau de sofisticação, a Deepfake é uma das mais perigosas ameaças à segurança online e obriga ao reforço de vigilância.

O panorama não é animador, conforme ilustram estudos como oDeepfake Statistics & Trends 2025: Growth, Risks, and Future Insights. Os ficheiros deepfake aumentaram de 500 mil em 2023 para uns projetados 8 milhões em 2025. As tentativas de fraude a dispararem 3.000% em 2023. Por exemplo, o Reino Unido registou 43,5 milhões roubados através de imitações usando deepfakes.

Os números confirmam a necessidade urgente de adotar tecnologias integradas e soluções proativas para dar uma resposta em conformidade. Sobretudo porque a generalidade das pessoas se mantém a anos luz de despertar para o risco deste expediente. De acordo com a Pesquisa Deezer/Ipsos, 97% do universo de pessoas abordadas não consegue distinguir conteúdos gerados por Inteligência Artificial daqueles que resultam da criatividade humana.

Alguns exemplos reais com imagens ou sons falsos

A inteligência artificial transformou-se numa arma silenciosa nas mãos de cibercriminosos. Os deepfakes, vídeos e áudios manipulados que imitam pessoas reais com precisão assustadora, estão a atingir proporções epidémicas. Em 2025, já não se trata de ficção científica. Trata-se de uma realidade que afeta empresas, cidadãos comuns e até governos.

Geradores de voz por IA agora replicam não apenas tom e volume, mas nuances emocionais e até sotaque regional. Os atacantes podem treinar modelos de voz multilingues e conscientes de emoções com apenas 30 a 90 segundos de áudio.

A clonagem de voz tornou-se acessível e pode criar um deepfake vocal convincente em menos de 30 segundos com ferramentas amplamente disponíveis na internet. Estes áudios falsos estão a ser usados para se fazer passar por executivos, familiares e agentes de apoio o cliente.

Imagine ser contactado por alguém que diz ser do seu banco e que o leva a partilhar credencias ou clicar em links que na realidade não são mais que esquemas de phishing. Ou pior, a possibilidade de clonarem a sua voz e utilizarem-na para abordagens fraudulentas junto de familiares ou amigos.

Ainda em fevereiro de 2024, o mundo despertava para o caso de uma empresa de Hong Kong que perdeu 25 milhões de dólares após uma videochamada com um CFO falsificado por deepfake. Os criminosos combinaram vídeo, áudio e documentação sintética para estes esquemas que se tornam mais difíceis de detetar.

Mas não só, há igualmente registo de extorsão por conteúdo fabricado com conteúdos sensível e de natureza sexual. Os atacantes recolhem fotos de redes sociais, geram imagens ou vídeos falsos de nudez e exigem pagamento sob ameaça de exposição.

Leia também:

- Sabe como fazer compras online em segurança?

- Como evitar que o seu cartão seja clonado

- Money muling: o que é e como pode proteger-se deste esquema

Qual o enquadramento da Lei?

Em Portugal, o crime de burla, previsto no artigo 217.º do Código Penal, estabelece penas de prisão até três anos ou multa para quem induzir alguém em erro para obter enriquecimento ilegítimo. Caso o prejuízo seja elevado, a pena pode atingir cinco ou oito anos de prisão.

Mas não só. Existem regras no âmbito da proteção de dados, no âmbito dos direitos de autor e propriedade intelectual, assim como uma Lei de Defesa do Consumidor e Segurança de Produtos. As regras de cibersegurança, nomeadamente a NIS2 visam também o uso de IA em áreas tão sensíveis como a Saúde; Energia ou Banca.

Porém, a especificidade dos esquemas com deepfake através da IA obrigou a um novo enquadramento legal. A Lei da Inteligência Artificial da União Europeia (EU), em vigor desde 2024, estabelece que conteúdos gerados ou modificados com recurso a IA, como deepfakes, precisam de ser claramente rotulados. A proibição de sistemas de IA com riscos inaceitáveis começou a ser aplicada a partir de 2 de fevereiro de 2025. Em Portugal e resto da Europa, este AI Act tem uma aplicação faseada até 2027.

O que está em causa?

Falamos de uma revolução acelerada e que envolve diversos pontos sensíveis da nossa vida quotidiana.

Implica com os nossos direitos individuais; dados pessoais; o próprio exercício da criatividade e defesa dos seus direitos autorais. Em fundo, e de modo mais ou menos sorrateiro, podemos estar diante de um dos maiores desafios da civilização moderna.

Ao confundir verdade e mentira, os truques criados pela deepfake podem arrastar uma crise grande de confiança nas pessoas e nas organizações. Daí a preocupação prioritária das empresas e destas organizações na defesa daquilo que é o seu património mais precioso - a sua reputação.

Deepfake: como identificar sinais de alarme?

Existem sinais que podem ajudar a identificar conteúdos manipulados, produzidos com esta base tecnológica

Em videochamadas e chamadas telefónicas

- Observe os movimentos naturais e a sua autenticidade. As ferramentas de IA generativa podem ter mais dificuldade em criar imagens tridimensionais;

- Confira se os seus interlocutores estão a usar plataformas licenciadas da nestas comunicações;

- Esteja atento às micro expressões dos seus interlocutores, à sua fisionomia, ao seu movimento e à coerência do olhar, onde a deepfake ainda se denuncia;

- Repare nas fontes de luz e sombras que podem ser inconsistentes;

- Atenção às gravações fabricadas que não reagem de modo natural às suas interpelações;

- Esteja atento aos ruídos de fundo descontextualizados;

- Mantenha-se alerta à voz, à naturalidade do seu tom e às suas reações

Deepfake: Como pode proteger-se?

Além destes sinais, pode sempre ter uma atitude ativa para evitar cair em engodos. Por exemplo:

- Mantenha-se atento à informação e às fraudes que podem estar a correr;

- Mantenha-se crítico e esclarecido com atenção a conteúdos de literacia que o podem ajudar;

- Nada de responder a pedidos ou instruções que lhe impõem urgência;

- Quando confrontado com um pedido inesperado, confira se o pedido que lhe estão a fazer no momento tem validade por outro canal. Por exemplo, ligue para os seus interlocutores;

- Pesquise rapidamente, junto de fontes confiáveis na net, se identifica alguma abordagem semelhante àquela de que está a ser alvo;

- Pode ainda investir em tecnologia. Há soluções de cibersegurança que incluem proteção contra deepfakes;

- Muito importante: Limite a exposição de dados biométricos (voz, imagem, íris) em redes sociais que podem facilmente ser roubadas, replicadas e usadas para esquemas de crime;

- Quando identifica conteúdos falsos ou fabricados para fins ilícitos, denuncie imediatamente às autoridades

Como pode denunciar estes crimes?

Denunciar um crime envolvendo deepfake exige rapidez e rigor.

O primeiro passo é preservar todas as provas digitais. Por exemplo, vídeos, capturas de ecrã, mensagens, emails e ligações usadas no esquema. A denúncia deve ser apresentada à Polícia Judiciária responsável por investigar cibercrime através da Unidade Nacional de Combate ao Cibercrime e Criminalidade Tecnológica. A PSP também recebe queixas presenciais ou online através do formulário de denúncia; ou à GNR em zonas não urbanas.

A queixa segue para o Ministério Público, que coordena investigações através do Gabinete de Cibercrime. Se o crime envolver transferências bancárias, contacte imediatamente o seu banco para tentar bloquear operações e ativar processos de recuperação.

Se o incidente ocorrer em redes sociais, plataformas de encontros ou videoconferência, reporte imediatamente nos canais próprios.

Os esquemas com deepfake são uma das formas mais sofisticadas de cibercrime em 2025. Ao combinar vídeo, áudio e identidades sintéticas com um realismo difícil de contestar exigem especial cuidado para detetar, preservar prova e denunciar rapidamente.

Portugal possui mecanismos formais de resposta. Polícia Judiciária, Ministério Público e entidades financeiras. No entanto a primeira linha de defesa continua a ser a sua literacia digital e as boas práticas que daqui resultam para se proteger a si; à sua família ou à sua empresa.

Leia Também:

- Euro digital: 10 perguntas e respostas sobre o que pode mudar

- Sabe o que é um cartão virtual? Descubra para que serve e como criar

- MB WAY: saiba como funciona esta app em 5 pontos essenciais

- Os cuidados essenciais a ter com o débito direto

- Iot: o que é a Internet das Coisas e como funciona?

- Como posso abrir uma conta à distância em segurança?

A informação deste artigo não constitui qualquer recomendação e não dispensa a consulta necessária de entidades oficiais e legais.